- nenna.ai news

- Posts

- 📬NENNA.AI Monthly Newsletter - März

📬NENNA.AI Monthly Newsletter - März

März 2025

Hallo, liebe NENNA.AI Follower

Willkommen zu unserer Märzausgabe!

Der Newsletter in diesem Monat enthält tolle Neuigkeiten über die Bitkom - Generative KI in Unternehmen, KI Assessment Framework, Microsoft und natürlich von NENNA. Scrollt nach unten, um mehr zu erfahren 👇

UND vielen Dank, dass Ihr Teil unserer Community seid! 💜

UNSERE THEMEN

Bitkom Leitfaden - Generative KI

NSW Assessment Framework

UPDATE NENNA

Microsoft Copilot

Was es sonst Neues gibt

Events

Bitkom

Generative KI im Unternehmen – Ein Leitfaden von Bitkom (UPDATE 2025)

Handlungsbedarf bei deutschen Unternehmen: Laut einer Bitkom-Umfrage sehen sich 64 % der Unternehmen als Nachzügler in Sachen KI, und 22 % glauben, den Anschluss bereits verpasst zu haben. Nur 10 % betrachten sich als Vorreiter. Dies unterstreicht den dringenden Bedarf an klaren Leitlinien und technische Unterstützung

Details:

Rechtliche Unsicherheiten bremsen den Fortschritt: Viele Unternehmen zögern beim Einsatz generativer KI aufgrund von Bedenken hinsichtlich Datenschutz, Urheberrecht und Haftungsfragen.

Aktualisierte Compliance-Anforderungen durch den AI Act: Die EU-weite KI-Verordnung bringt neue Verpflichtungen mit sich, insbesondere in Bezug auf Transparenz und Risikobewertung. Unternehmen müssen ihre Compliance-Strategien entsprechend anpassen.

Ethische Verantwortung im Umgang mit KI: Neben rechtlichen Aspekten gewinnt die ethische Dimension an Bedeutung. Unternehmen sollten sicherstellen, dass ihre KI-Systeme transparent, fair und nachvollziehbar agieren.

Warum das wichtig ist:

Diese Erkenntnisse verdeutlichen, dass der erfolgreiche Einsatz generativer KI nicht nur technisches Know-how erfordert, sondern auch ein tiefgehendes Verständnis für rechtliche und ethische Rahmenbedingungen

NWS

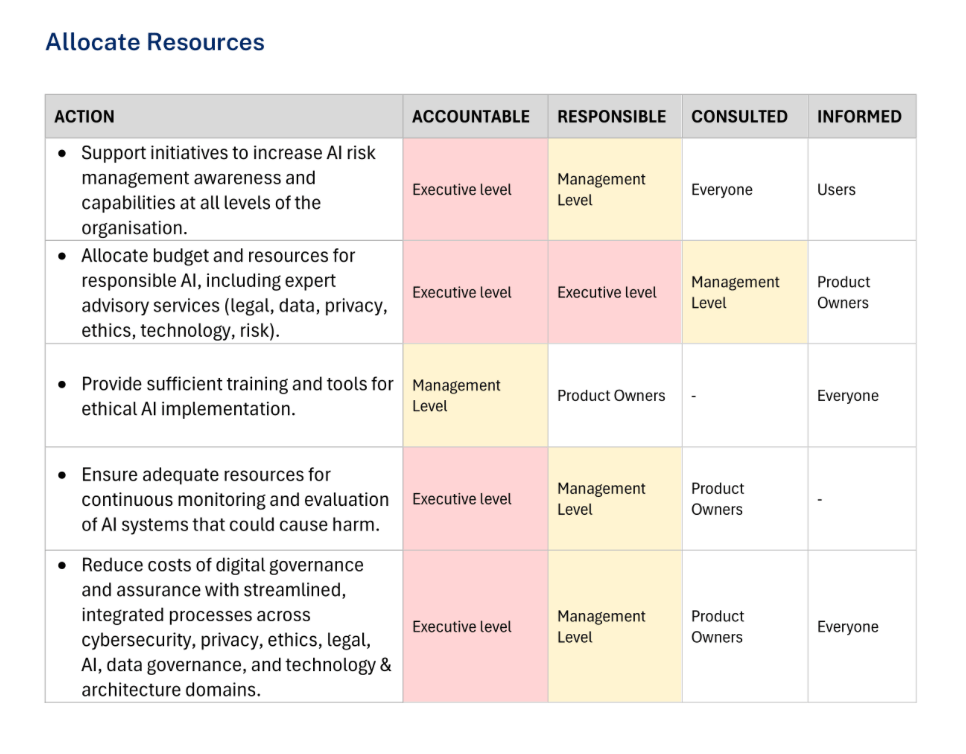

Verantwortlichkeiten im Umgang mit Künstlicher Intelligenz (KI) – NSW Assessment Framework)

Die Regierung von New South Wales hat ein tolles Beispiel für die Definition von klaren Verantwortlichkeiten für den ethischen, sicheren und transparenten Einsatz von KI in öffentlichen Einrichtungen vorgestellt. Die Vorgaben stützen sich auf internationale Standards (z. B. ISO/IEC) und fördern einen verantwortungsvollen KI-Einsatz durch Governance, Kultur und Ressourcen.

Details:

Ethische und verantwortungsvolle KI-Kultur aufbauen: Führungskräfte müssen ethische Prinzipien für KI in ihre Organisationswerte, Kommunikation und Entscheidungsprozesse integrieren – mit Vorbildfunktion von oben.

Transparenz, Rechenschaft und Governance sicherstellen: Rollen und Verantwortlichkeiten für den gesamten KI-Lebenszyklus (Design, Entwicklung, Einsatz) müssen klar definiert und dokumentiert sein – inklusive Mechanismen zur regelmäßigen Kontrolle und Risikobewertung.

Ressourcen und Kompetenz gezielt aufbauen: Organisationen sollen ausreichende finanzielle Mittel, Schulungen und Fachwissen bereitstellen, um KI-Systeme verantwortungsvoll zu planen, einzusetzen und zu überwachen.

Warum das wichtig ist:

Nur durch eine klare und proaktive Zuordnung von Zuständigkeiten kann KI verantwortungsvoll und nachhaltig eingesetzt werden – insbesondere in Bereichen mit gesellschaftlicher Wirkung. Das stärkt Vertrauen, minimiert Risiken und fördert den langfristigen Nutzen von KI.

NENNA

Transform

Wir waren diesen Monat auf verschiedenen Veranstaltungen unterwegs u.a. auf der Transform in Berlin. Unser Head of Business Development, Florian Spengler, durfe dort an einem Panel zu KI & Datenschutz teilnehmen. Wenn Ihr dazu mehr erfahren wollt, gerne das Video anschauen!!

Zudem haben wir unsere Hilfeseite aktualisiert, wenn Ihr jetzt einen kurzen Walktrough durch NENNA machen wollt, gerne hier schauen:

Microsoft

Microsoft Copilot verstößt gegen EU-KI-Verordnung

Ein Kurzgutachten argumentiert, dass Microsofts Copilot gegen mehrere Kernpunkte der EU-KI-Verordnung (KI-VO) verstößt, insbesondere Artikel 5. Der Copilot betreibt demnach Praktiken, die nach der Verordnung ausdrücklich verboten sind, was zu einer Unzulässigkeit seines Einsatzes führen könnte.

Details:

Verdeckte Beeinflussung durch Datensammlung und Profilbildung: Microsoft Copilot analysiert kontinuierlich Nutzereingaben und -verhalten, um daraus Profile zu erstellen, ohne dass dies für die Nutzer transparent oder nachvollziehbar ist – eine Form unterschwelliger Beeinflussung, die nach Art. 5 Abs. 1 lit. a KI-VO verboten ist.

Einsatz von „Confidence Scores“ als soziale Bewertung: Copilot vergibt sogenannte „Confidence Scores“ von 1 bis 5, die Auskunft über die erwartete Zuverlässigkeit eines Nutzers geben. Solche Bewertungen können – ob direkt oder indirekt – zu Diskriminierungen und Nachteilen führen und sind laut Art. 5 Abs. 1 lit. c KI-VO als soziale Bewertung unzulässig.

Verstoß gegen gesetzliche Verbote trotz kommerzieller Nutzung: Auch wenn Copilot als kommerzielles Tool bereitgestellt wird, ist der Einsatz verbotener Praktiken unabhängig vom Anwendungsbereich rechtswidrig.

Warum das wichtig ist?

Der Fall zeigt, dass auch große Technologiekonzerne die europäischen KI-Regularien strikt beachten müssen – gerade bei tief in die Produktivitätstools integrierten Assistenten wie Copilot. Nur durch Einhaltung der Regeln können Vertrauen, Rechtssicherheit und der Schutz individueller Freiheiten gewährleistet werden

Updates

Was es sonst neues gibt

OpenAI: OpenAI hat mit GPT-4o Bildgenerierung ein neues KI-Modell vorgestellt, dass täuschend echte Bildausgaben produziert. Die Fähigkeiten des Modells sind beeindruckend, bergen aber auch erhebliche Missbrauchsgefahren für Desinformation und Identitätsdiebstahl, sowie Urheberrechtsverletzungen. BTW. wir mussten es auch ausprobieren:

eBay: eBay plant, ab dem 21. April 2025 personenbezogene Daten seiner Nutzer:innen zum Training eigener KI-Modelle zu verwenden. Diese Änderung wird Teil einer aktualisierten Datenschutzerklärung – betroffen sind z. B. Chatverläufe mit dem Kundenservice oder Formulareingaben. Diese Änderung wirft wichtige Fragen zum Datenschutz und zur Transparenz im Umgang mit KI auf – und zeigt, wie Plattformen versuchen, ihre KI-Strategien mit vorhandenen Nutzerdaten voranzutreiben.

Microsoft: Microsoft-CEO Satya Nadella betont, dass KI-Modelle zunehmend zu standardisierten Produkten werden. Der entscheidende Wettbewerbsvorteil liegt nun darin, wie effektiv Unternehmen diese Modelle in umfassende Produkte und Systeme integrieren.

Meta: Meta hat mutmaßlich illegale Schattenbibliotheken wie LibGen genutzt, um seine KI-Sprachmodelle zu trainieren, ohne Autoren und Verlage zu entschädigen. Diese Praxis führte zu Klagen von Autoren wie Richard Kadrey und Christopher Golden

Events

Wo Ihr uns finden könnt

Wir sind in der kommenden Zeit auf diesen Veranstaltungen, wenn Ihr uns gerne mal persönlich treffen wollt, kommt dort vorbei:

April

Mai

6./7.5 OMR - Hamburg - Masterclass